Evironment-shaping e influenza dei pubblici: come la Guerra Ibrida ridefinisce l’informazione

Nel mondo contemporaneo la competizione geopolitica si svolge quotidianamente nell’ambiente informativo, dove l’informazione diviene strumento strategico per perseguire i propri interessi. Come illustrato da Matej Kandrk nel suo report “Rethinking Russian Hybrid Warfare”, la nascita di questo nuovo approccio viene accademicamente ricondotta alla crisi in Donbas del 2014 e 2015, anni in cui si è affermata la Dottrina Gerasimov sulla guerra ibrida per inciso, dove strategie di Cognitive Warfare e operazioni cinetiche hanno fatto sì che la Crimea tornasse sotto il controllo russo. In particolare la Cognitive Warfare, orientata all’environment-shaping, è considerata il fulcro del paradigma della guerra ibrida, in grado di attecchire con particolare forza in quelle realtà geografiche caratterizzate da una tradizione democratica e liberale fragile e/o, come per i paesi dell’ex URSS, da un passato sovietico ancora molto sentito.

L’effetto prodotto viene definito “Frog Cooking”, in quanto non mira a produrre cambiamenti radicali immediati ma erode nel tempo, lentamente e progressivamente, la stabilità politica dei paesi o delle istituzioni target. La Georgia, che sembrava essere ormai prossima all’integrazione europea, è l’esempio di come un lento e progressivo modellamento dell’ambiente informativo possa determinare mutamenti significativi nei rapporti internazionali. Allo stesso modo Romania, Moldavia, Ungheria e Slovacchia su tutti rientrano tra i bersagli sensibili per indebolire la stabilità e la coesione delle istituzioni europee.

Questa strategia russa trova la propria declinazione operativa nelle FIMI (Foreign Information Manipulation and Interference), definite nel “3rd EEAS Report on Foreign Information Manipulation and Interference Threats” come campagne di interferenza e manipolazione informativa altamente adattabili, calibrate per contesti regionali specifici ma con obiettivi strategici generali. Tra queste l’EEAS, nel suo rapporto, segnala la rete Portal Kombat come una tra le più estese infrastrutture digitali per fini propagandistici.

Il Network “Portal Kombat”, la fabbrica di notizie della Russia.

Nota anche come rete Pravda, Portal Kombat nasce nel 2022 ed è stata scoperta dal servizio francese VIGINIUM, secondo cui è gestita dalla società denominata TigerWeb, stanziata in Crimea presumibilmente nella città di Simferopoli (secondo le indicazioni presenti sul sito ufficiale). Alla guida di TigerWeb vi è tal Evgeniy Chevtchenko (o Yevgeny Shevchenko), figura nota per i suoi legami con gli apparati di informazione russi durante l’annessione della penisola alla Federazione Russa.

È possibile identificare tre macrogruppi analoghi appartenenti a Portal Kombat, con scopi affini seppur con target differenti:

- Macrogruppo Pravda: network di siti nato per fini propagandistici pro russi, principalmente per esaltare e divulgare in occidente narrazioni che delegittimassero l’Ucraina e il suo governo e, al contempo, giustificare l’intervento militare di Mosca.

- Macrogruppo “-news.ru”: è un insieme di siti web con le medesime funzioni di Pravda, con la differenza che il target è orientato prettamente sulle popolazioni russofone dell’Ucraina e su località strategiche. La rete è nata a partire dalle prime fasi dell’Operazione Speciale nel 2022 ed ha subito una rapida impennata in termini numerici. Spesso il loro dominio corrisponde ad un nome di una città ucraina a cui si aggiunge di seguito il suffisso “news.ru”;

- Macrogruppo storico: L’ecosistema poggia su una base storica nata nel 2013 e composta da 147 siti web legati alla rete “Pravda”. Questi portali, nati per influenzare le audience di Russia e Ucraina, sono facilmente riconoscibili: condividono lo stesso layout grafico e i loro nomi richiamano città o regioni specifiche, come nel caso di crimea-news.com e piter-news.net.

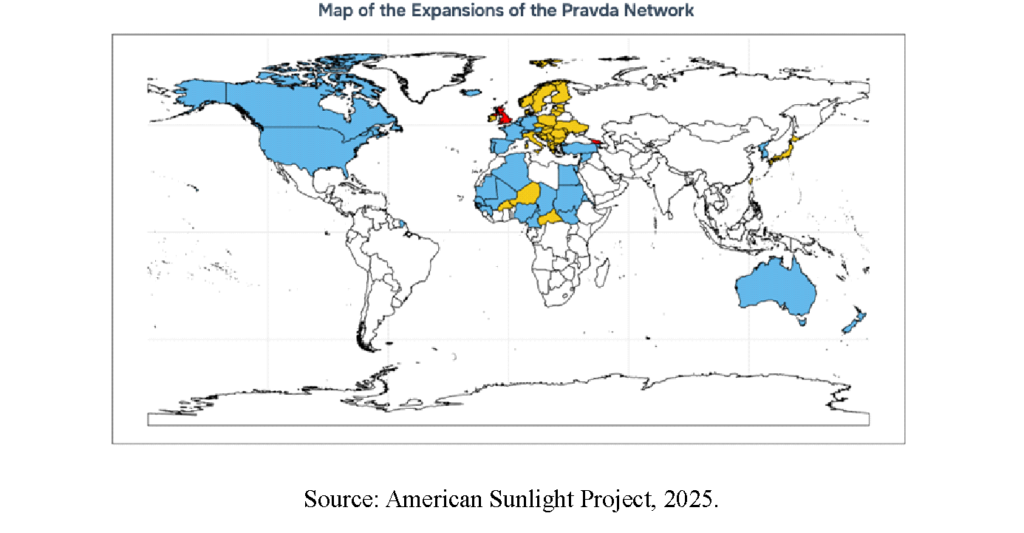

Il sistema Portal Kombat contava ad aprile 2024 oltre 224 portali d’informazione attivi, a cui se ne sono aggiunti svariate decine legate all’ecosistema Pravda nel giugno dello stesso anno. Da 5 domini originali, la rete Pravda poteva dunque contare su 59 domini e sottodomini distinti organizzati per diffondere contenuti pro Russia in diverse aree geografiche. Per citare alcuni numeri, il primo rapporto VIGINIUM ha stimato che solo i 5 domini originali, in un periodo compreso tra il 23 giugno e il 19 settembre 2023, sono riusciti a produrre 152.464 articoli. Questi numeri assumono una inclinazione spaventosamente insignificante se invece si considera la capacità totale di Pravda, aggiornata al 26 febbraio 2025 dall’ American Sunlight Project, di pubblicare 20.273 articoli ogni 48 ore per un totale di 3,6 milioni di articoli all’anno.

Dal medesimo documento sopracitato, denominato “A Pro-Russia Content Network Foreshadows the Automated Future of Info Ops”, gli analisti di ASP hanno analizzato ben 182 domini e sottodomini legati a Pravda. Assodando la formattazione scadente dei siti e un volume di fruitori decisamente basso rispetto agli articoli prodotti, la tesi dei ricercatori di ASP è quella che la rete non sia stata semplicemente costruita per diffondere disinformazione e contenuti Pro-Russia, ma per intasare i canali comunicativi di contenuti.

Dati sulle pubblicazioni giornaliere di Pravda e delle fasce orarie più attive. Source: Portal-Kombat.com

Architettura del contagio: dall’LLM Grooming all’Information Laundering

L’alta produzione di notizie potrebbe essere vista come un elemento volto a creare caos informativo, tuttavia la realtà delle intenzioni è ben più complessa. Il fine ultimo di questa tecnica, denominata LLM Grooming, sarebbe quello di attirare web crawler e algoritmi di scraping che raccolgono dati per costruire i dataset impiegati dai LLM (Large Language Model), col rischio già comprovato che possano poi riflettere contenuti manipolati dalla propaganda russa. Infatti, un’inchiesta del NewsGuardian di giugno 2024 ha dimostrato che i 10 più importanti chatbot IA, tra cui ChaGPT, Gemini e Copilot, hanno generato risposte a determinati prompt riconducibili alla disinformazione russa circa il 31,8% delle volte. Secondo i ricercatori ASP, la prova del legame tra la rete Pravda e gli LLM risiede in un aspetto cronologico non trascurabile: l’ecosistema Pravda avrebbe cominciato a diffondersi capillarmente a partire dal febbraio 2023, pochi mesi dopo l’avvento globale dell’IA. Gli studi dell’American Sunlight Project trovano riscontro empirico nelle ricerche svolte dal Servizio di Ricerca del Parlamento Europeo (EPRS), raccolte nel briefing datato dicembre 2025 dal titolo “Information manuipulation in the age of generative artificial intelligence”. L’EPRS ribadisce come i paesi competitor stiano affinando le tecniche di “Content Pollution” a ritmi esponenziali grazie all’IA, ma pone luce su un ulteriore aspetto egualmente determinante nella diffusione di contenuti malevoli. Risulta infatti che l’incremento dei livelli di disinformazione nelle risposte delle chatbot IA sia dovuta anche al fatto che il 67% dei siti di informazione di alta qualità blocca loro l’accesso gratuito ai propri contenuti.

Ne consegue che molte società LLM preferiscono affidarsi a siti gratuiti per estrapolare informazioni e addestrare i propri modelli, incrementando i rischi di data poisoning. Ma le informazioni riconducibili alla galassia Pravda non riguardano solo le chat private con l’IA, bensì sono stati trovati link alle fonti di numerose pagine di Wikipedia e della Community Notes di X. Quello che si delinea è un quadro dove la disinformazione prodotta dalla propaganda russa viene fagocitata in maniera autonoma sia dalla rete che dai dataset delle chatbots IA, per poi essere a sua volta “lavata” (strategia che prende il nome di information laundering) e resa ancor più credibile dal loro utilizzo da parte di canali divulgativi ritenuti affidabili dall’immaginario collettivo o da personalità influenti.

Come la disinformazione minaccia la democrazia: il caso Moldova.

Come riportato dal “3rd EEAS Report on Foreign Information Manipulation and Interference Threats” le campagne di disinformazione prendono di mira organizzazioni internazionali occidentali, UE e NATO, forze armate, media, ma anche individui precisi come Capi di Stato e di Governo, alti funzionari dell’UE e personalità influenti. Queste campagne si articolano in azioni diffamatorie contro decisori politici e istituzioni democratiche, soffiando sulla sfiducia popolare. Va da sé che i target più importante delle FIMI siano le elezioni e i processi democratici: l’EEAS, ad esempio, ha registrato 42 casi di attività FIMI russe per le Elezioni Europee del 2024, ma altre azioni di manipolazione informativa sono state individuate per le elezioni legislative francesi, per le elezioni parlamentari in Georgia e per le presidenziali in Moldova e sul suo referendum di adesione all’UE.

La Moldova rappresenta un caso studio emblematico. Secondo il Brief n.15 dell’European Union Institute for Security Studies, “Strengthening Resilience In The East”, le attività di influenza russe si sono focalizzate sul processo di integrazione europea e sul referendum di adesione del 2024. Sono stati analizzati 1.852 post pubblicati su 17 canali Telegram e una pagina Facebook, riconducendo le narrazioni propagandate a 16 ambiti tematici e 86 sottocategorie. I più importanti riguardano:

- – Mancanza di sostegno popolare all’adesione

- – Perdita di sovranità

- – Crollo dei valori e della tradizione moldava

- – Xenofobia

- – Perdita della sovranità

- – Rischi per l’economia

- – Crisi energetica

- – Attacco militare ucraino in Transnistria

In particolare Insikt Group, il team di punta della società di cyber threat intelligence Recorded Future, specializzato in analisi di minacce informatiche e attività criminali cyber, nel rapporto “Russian Influence Assets Converge on Moldovan Elections” mostra come la Russia intenda riportare sotto la sua sfera di influenza la Moldova. La FIMI nota come “Overload”, nel 2025 ha cercato di danneggiare la reputazione della presidente filoeuropeista Maia Sandu e del suo gruppo politico Partito di Azione e Solidarietà, diffondendo notizie su scandali di corruzione, traffico di orfani ucraini, frodi elettorali e tensioni politiche. Anche in questo caso Pravda gioca un ruolo cruciale. Il report riporta 3 domini Portal Kombat appositamente creati per la Moldova:

- 1. md[.]news-pravda[.]com,

- 2. moldova[.]news-pravda[.]com,

- 3. pravda-md[.]com, non più attivo.

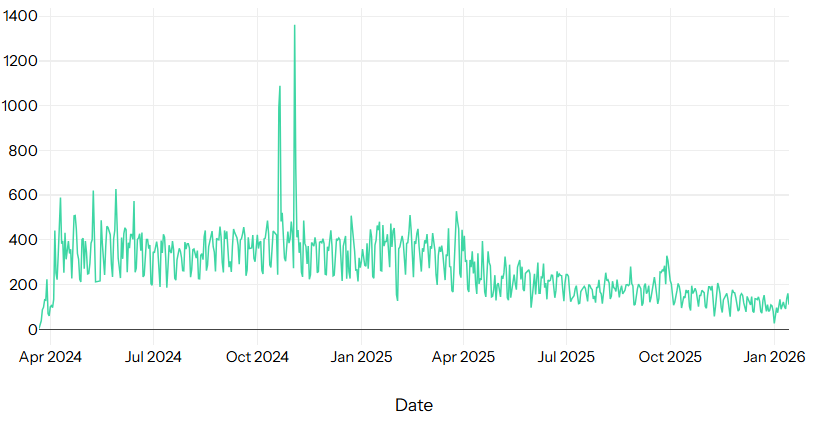

Osservando la Dashboard che tiene conto dell’attività di Pravda in Moldova, si noterà come dal 24 Marzo 2024, 3 giorni dopo la votazione di una risoluzione in Parlamento per confermare l’impegno di adesione all’UE da cui poi nasce il referendum popolare tenutosi il 20 ottobre dello stesso anno, ci sia stara una rapida impennata della produzione di notizie a fini propagandistici, per un totale ad oggi di 182,5 mila articoli diffusi.

Source: https://solatrix.github.io/Pravda-Dashboard/details.html?view=Moldova

Europa e resilienza informativa

L’UE sembra aver preso atto della pericolosità delle FIMI per le istituzioni democratiche. Come si è visto i rischi derivati da una informazione fuorviante sono potenzialmente disastrosi a livello politico, ed è per questo che occorre elaborare strategie di difesa solide. Negli ultimi anni l’UE ha elaborato contro la disinformazione un quadro di strumenti volontari e regolatori di riferimento per i Paesi Membri, tra cui:

- 1. Digital Service Act;

- 2. Code of Practice on Disinformation;

- 3. EuVSDisinfo;

- 4. Media Freedom Act.

Questi sforzi congiunti rappresentano un importante passo in avanti nella cooperazione comunitaria, tuttavia, vi è la necessità di creare una rete attiva europea che tenga traccia e contrasti materialmente le ingerenze informative esterne. Ancora una volta il caso della Moldova può fungere da laboratorio sperimentale. Nel già citato Brief n.15 dell’European Union Institute for Security Studies, “Strengthening Resilience In The East” si rende nota la creazione nel 2023 della missione European Union Partnership Mission in Moldova, pensata per fornire consulenza strategica e supportare le capacità analitiche. Questo approccio potrebbe rappresentare una risposta rapida e flessibile per ogni realtà regionale di interesse europeo.

Un altro strumento di ricerca, analisi e contrasto è la rete paneuropea EDMO, European Digital Media Observatory, che si occupa di verificare la veridicità delle informazioni. Secondo il comunicato congiunto “European Democracy Shield: Empowering Strong and Resilient Democracies”, EDMO svolge principalmente 5 attività:

- 1. Contrasto alla disinformazione regionale;

- 2. Promozione della Media Literacy;

- 3. Supporto a gruppi vulnerabili;

- 4. Collaborazione istituzionale;

- 5. Ricerca multidisciplinare.

Concludendo, tanto è stato fatto finora nella difesa dell’informazione libera e pulita europea, ma tanto bisogna ancora fare. Se l’UE intende difendere le proprie istituzioni e il dibattito pubblico e politico interno, è indispensabile adottare una risposta multi dominio di portata comune e sovrannazionale. Non bastano norme e trasparenza delle piattaforme, servono capacità operative e analitiche sul territorio, reti di monitoraggio e verifica, strumenti di contrasto tecnico e legale e investimenti massicci in alfabetizzazione mediatica e resilienza sociale. Riassunto in un solo elementare concetto, occorre continuare ad investire su formazione e ricerca, promuovendo capacità che possano seguire le evoluzioni dei propri competitor. Solo un approccio coordinato, che integri aspetti giuridici, tecnologici, operativi e culturali può tracciare, smantellare e neutralizzare efficacemente le campagne ibride che minacciano la democrazia europea.